Noch nie gab es so viele Ermittlungsverfahren und Hausdurchsuchungen wegen bloßer Worte. Heute gelten etliche politische Aussagen als strafbar, die noch vor zehn Jahren ganz klar erlaubt waren. Dabei sollten wir gerade in der gegenwärtigen Lage mehr Meinungsfreiheit wagen.

Ronen Steinke ist Leitender Redakteur im Politikressort der Süddeutschen Zeitung und Lehrbeauftragter an der juristischen Fakultät der Goethe-Universität Frankfurt am Main. Heute erscheint sein neues Buch Meinungsfreiheit: Wie Polizei und Justiz unser Grundrecht einschränken – und wie wir es verteidigen im Berlin Verlag. Wir veröffentlichen das Vorwort mit freundlicher Genehmigung von Autor und Verlag. Alle Rechte vorbehalten.

Das zentrale Prinzip, auf dem jede Demokratie beruht, die Meinungsfreiheit, entzweit die Demokratien gerade gewaltig. Die USA auf der einen Seite, Europa auf der anderen.

Im Februar 2025 trat auf der Münchner Sicherheitskonferenz der amerikanische Vizepräsident J. D. Vance in einem Luxushotel auf die Bühne in einem Saal voller europäischer Regierungsvertreterinnen und Regierungsvertreter – und schaltete gleich auf Angriff. Europa würge die Meinungsfreiheit ab, behauptete der Amerikaner, dunkler Anzug, blaue Krawatte, ernster Ton. Die größte Bedrohung für Europa heute komme gar nicht mehr aus Russland oder China, sondern „von innen“. Infolge eines, wie Vance es ausdrückte, „Rückzugs Europas von einigen seiner grundlegenden Werte“. Dann belehrte der US-Vizepräsident seine Zuhörer – und besonders seine deutschen Gastgeber – darüber, dass die „Demokratie auf dem heiligen Prinzip ruht, dass die Stimme der Menschen ein Gewicht hat“.

Mit Blick auf die zahlreichen, immer schärfer werdenden europäischen Gesetze gegen sogenannte Hassrede, also solche Dinge wie die staatlichen „Zensurwünsche“ an die Adresse sozialer Medien wie Facebook oder X, die staatlich verordneten Online-Blocker und -Filter, wie sie vor allem Deutschland in den zurückliegenden zehn Jahren stark forciert hat, formulierte der Gast aus den USA: „Firewalls haben da keinen Platz.“ Das Prinzip der Meinungsfreiheit verlange nämlich eine spezielle Fähigkeit von Regierenden: die Fähigkeit, Kritik zu erdulden. „Entweder man hält dieses Prinzip hoch, oder man hält es nicht hoch.“

Entsetzen und Belustigung

Stille herrschte im Saal, europäische Teilnehmer waren für einen Moment sprachlos, und einige erzählten hinterher, wie sie innerlich geschwankt hätten zwischen Gefühlen des Entsetzens, aber auch der Belustigung. Denn, natürlich: Von Leuten wie J. D. Vance, die in ihrer Heimat kritische Journalisten diffamieren, Universitäten unter Druck setzen und Late-Night-Show-Hosts wegmobben, lässt man sich nicht so gern über demokratische Tugenden belehren. Für deutsche Politiker war es ein Leichtes, darauf hinzuweisen, dass der Amerikaner nicht wirklich gut positioniert sei, um über den Respekt vor abweichenden Meinungen zu dozieren.

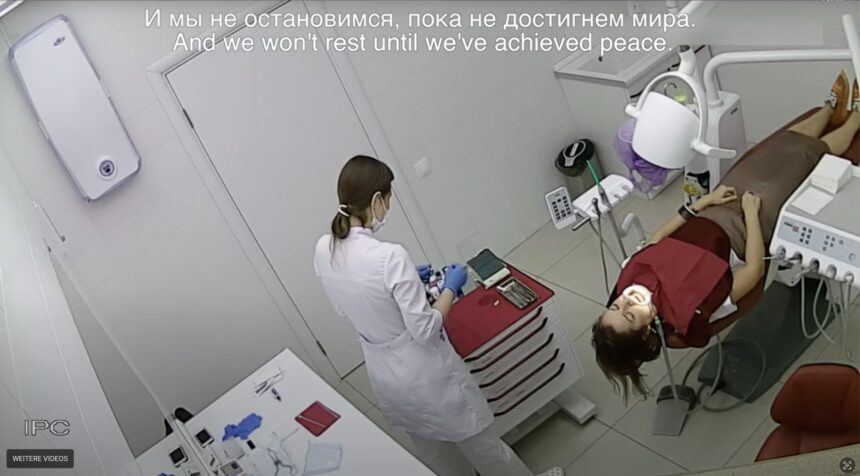

Immerhin, gerade hatte die Regierung des US-Präsidenten Donald Trump und seines Vizes Vance die Nachrichtenagentur Associated Press achtkantig aus dem Weißen Haus geworfen, weil die Journalisten sich die Freiheit genommen hatten, den Golf von Mexiko weiterhin als „Golf von Mexiko“ zu bezeichnen, während die Trump-Regierung lieber kindisch von einem „Golf von Amerika“ sprechen wollte. Gleichzeitig hatte in den USA der Kampf gegen unliebsame Stimmen, auch mit drastischen Mitteln wie der Durchsuchung von Handys und sozialen Netzwerken nach kritischen Äußerungen gegen Amerikas Verbündeten Israel, gerade erst begonnen.

Sprachtabus in Deutschland

Aber, schrecklicher Gedanke: Was, wenn der Gast aus Amerika dennoch einen Punkt hatte? Der US-Vizepräsident ist schließlich nicht der Erste, der in Bezug auf Europa etwas bemerkt hat, auch Linksliberale in den USA blicken gegenwärtig mit zunehmend mulmigen Gefühlen auf das, was sich in Europa und besonders in Deutschland vollzieht. Von außen sieht man Dinge vielleicht manchmal klarer als von innen: Schon immer war die Bundesrepublik innerhalb der westlichen Welt das Land mit den meisten Sprachtabus, den schärfsten Strafvorschriften gegen bloße Worte, freedom of speech wird hier traditionell kleiner geschrieben als in den USA. Und: In dem Jahrzehnt zwischen 2015 und 2025, in dem die demokratische Kultur sich beiderseits des Atlantiks als äußerst volatil erwiesen hat und die Demokratie in einen Stresstest geraten ist, hat Deutschland sich entschieden, noch einmal deutlich mehr vom selben zu versuchen.

Das heißt, Deutschland hat darauf gesetzt, noch einmal zusätzliche Gesetze zu schaffen sowie auch alte, schon bestehende Gesetze zu verschärfen, um politische Äußerungen stärker zu regulieren und einzuschränken. Der Bundestag hat Strafparagrafen erweitert und vermehrt, der Tatbestand der Volksverhetzung ist gleich in mehrfacher Hinsicht ausgebaut worden, der Tatbestand der öffentlichen Billigung von Straftaten ist so ausgedehnt worden, dass man jetzt schon dafür bestraft werden kann, wenn man Taten „befürwortet“, die allein in der Fantasie spielen. Viele Staatsanwaltschaften haben die Bekämpfung von Hatespeech zu einer neuen Priorität erhoben, sie haben neue, schlagkräftige Teams gegründet, um zu ermitteln und juristische Spielräume auszuschöpfen.

Noch nie hat es hierzulande so viele Ermittlungen wegen bloßer Worte gegeben. Wegen reiner Äußerungsdelikte, wie Juristinnen und Juristen sagen. Die Zahlen der Ermittlungen haben sich in diesem Jahrzehnt – je nachdem, welchen Tatbestand man ansieht – teils verdreifacht, vervierfacht, verfünffacht, bei manchen, früher völlig unbekannten Delikten wie der öffentlichen Billigung von Straftaten sogar verhundertfacht, von jährlich knapp 20 auf 2000. Selbst wegen des Uraltdelikts der Blasphemie, „Beschimpfen von Bekenntnissen“, gab es im Jahr 2024 plötzlich 125 Ermittlungen – ein Rekord. Das liegt zum einen sicher daran, dass das Internet nichts vergisst und Äußerungen dort technisch leichter zu dokumentieren sind als im analogen Raum. Zum anderen aber auch daran, dass die Bereitschaft des Staates, auf Worte mit Verboten und Strafen zu reagieren, groß ist wie nie.

Vulnerable Gruppen schützen

Anfangs ist dies zweifellos aus besten Absichten geschehen. Als es losging mit der härteren Gangart, etwa 2015/16, lautete die Idee, dass man vor allem vulnerable Gruppen besser davor beschützen müsse, niedergebrüllt zu werden. Das ist richtig – ein wichtiger Gedanke. Als etwa die ZDF-Journalistin Dunja Hayali sich im Sommer 2025 zu einem tödlichen Attentat in den USA äußerte, dem Anschlag auf den Rechtsradikalen Charlie Kirk, da prasselten in den sozialen Medien so viele Kommentare auf sie ein, dass einen der Mut zum offenen Wort schon mal verlassen könnte. Hayali hatte unter anderem gesagt, es sei nicht zu rechtfertigen, dass manche Gruppen Kirks Tod feierten – „auch nicht mit seinen oftmals abscheulichen, rassistischen, sexistischen und menschenfeindlichen Aussagen“. Das genügte schon, um manche zu triggern.

„Sie werden bald für ihre Äußerungen bitter bezahlen“, schrieb @gordons_katzenabenteuer auf Instagram an die Journalistin, „Sie haben nur das allerschlimmste verdient. Schauen sie lieber ab jetzt öfter über ihre Schulter.“ Ein Nutzer namens @nocebo_the_mortem schrieb: „Ich hoffe, sie werden auch vor ihrer Familie erschossen“. @jaroabroad pflichtete bei: „Du bist ein Stück Scheiße sondergleichen und die Drohungen sind völlig gerechtfertigt!“ @juki030 schrieb: „Wir werden dich noch hängen sehen!“ @team.114hrc schrieb: „Heul leise du Dre…… Wirst bald die nächste sein“. @volkersuthoff schrieb: „Hoffentlich erschießt dich einer, du miese dreckslesbe!“

Wenn Täter mit solchen Gewaltdrohungen durchkämen, dann bliebe von der Meinungsfreiheit der Bedrohten nicht viel übrig. Zumal solche Attacken oft strategisch sind. Eine Studie der britischen Zeitung The Guardian ergab, dass von den zehn am häufigsten in Online-Kommentaren beleidigten Autorinnen und Autoren der Zeitung acht Frauen waren, vier von ihnen nicht weiß. Die anderen beiden waren schwarze Männer. In Deutschland sind Menschen mit Migrationshintergrund mehr als doppelt so oft von Online-Beschimpfungen betroffen wie andere. Das sind Menschen, die noch nicht sehr lange eine Stimme im politischen Diskurs haben und die aus Sicht der Pöbler wieder „auf ihre Plätze“ verwiesen werden sollen. Dahinter steckt der Wunsch, diese Gruppen gezielt aus dem Diskurs herauszutreiben.

Über Ziel hinausgeschossen

Das ist reaktionär, es ist antidemokratisch. Dagegen braucht es eine Verteidigung. Auch durch den Staat. Aber: Inzwischen ist der deutsche Strafverfolgungsapparat weit über dieses Ziel hinausgeschossen. Zunehmend geht es nicht erst bei Drohungen los, sondern schon bei viel harmloserem Spott. Wird ein Mensch in Deutschland „dämlich“ oder „Schwachkopf“ genannt, dann ist normalerweise klar, dass das keine Staatsanwaltschaft in Bewegung versetzt. Widerfährt das einem Politiker oder einer Politikerin, dann bilden sich gerade neue Maßstäbe heraus. Ein Bürger in Bayern bekam einen Strafbefehl, weil er die Grünen-Politikerin Annalena Baerbock als die „dümmste Außenpolitikerin der Welt“ bezeichnet hatte. Ein Fall für den neuen Strafparagrafen der „Politikerbeleidigung“.

Seit 2021 werden Beleidigung, üble Nachrede und Verleumdung gegen „Personen des politischen Lebens“ in einem einzigen Paragrafen zusammengefasst. Die Zahl der Ermittlungsverfahren, die der Staat auf dieser Grundlage eingeleitet hat, hat sich seither jährlich verdoppelt. 2021 waren es 748, im Jahr darauf schon 1.404. Im Jahr darauf dann 2.598. Und dann, zuletzt, 4.439 Fälle Fälle. Wohlgemerkt: Um Bedrohungen – oder andere Formen von Gewalt – geht es hier nicht.

Wie weit ist zu weit?

Der neue Wind weht scharf: Bis vor zehn Jahren war es noch undenkbar, dass die Polizei im Morgengrauen zu Razzien in Privatwohnungen anrückt, allein weil jemand das juristische Delikt der Beleidigung begangen haben soll, das in der Regel nur zu sehr geringen Strafen führt. Man hätte es für unverhältnismäßig gehalten. Eine Durchsuchung ist ein schwerer Grundrechtseingriff. Heute geschieht dies dagegen laufend, bei „Aktionstagen“ wird gleich an Dutzenden oder gar Hunderten Türen von Tatverdächtigen parallel geklingelt.

Man liest darüber sogar in der New York Times, in Artikeln, deren Autoren allerdings verwundert klingen über die Entwicklung der Meinungsfreiheit auf dem alten Kontinent. „Wie weit kann man gehen, bevor es zu weit geht?“, schrieben zwei Europa-Korrespondenten der Zeitung in einer langen Reportage im September 2022 über die neue Strenge, mit der Deutschland weiter gehe als „jede westliche Demokratie“. How far is too far?

Razzia wegen „Pimmel“

Hausdurchsuchungen erleben nun zunehmend auch Menschen, die im Netz ihre Meinung zu Ereignissen der internationalen Politik äußern. In den aufwühlenden Debatten zum Nahostkonflikt zum Beispiel war dies der Fall. Als ein Mann in München bei Instagram schrieb, dass das Massaker der palästinensischen Terrormiliz Hamas gegen israelische Zivilistinnen und Zivilisten am 7. Oktober 2023 natürlich entsetzlich sei, andererseits aber ein besetztes Volk das „legitime Recht auf Widerstand mit allen notwendigen Mitteln“ habe, genehmigte das Amtsgericht die Beschlagnahme seines Handys und anderer „internetfähiger Endgeräte“. Das kam unerwartet. Dass Menschen in Diskussionen solche kruden Aussagen einwerfen, die förmlich danach rufen, dass andere Menschen ihnen in der Diskussion widersprechen und mit Kontext oder Differenzierung antworten, ist nicht neu. Dass dies solche strafrechtlichen Interventionen nach sich zieht, ist durchaus neu.

In den Debatten zur innerdeutschen Politik ist dies ebenso zu beobachten. So hat etwa ein altgedienter Lokalpolitiker der Grünen in München erlebt, dass ihm verboten wurde, dem bayerischen Vizeministerpräsidenten Hubert Aiwanger von den Freien Wählern vorzuwerfen, dessen „Hetze“ gegen die Grünen ähnele in ihrer Sündenbock-Struktur der einstigen antisemitischen Agitation der Nazis. Der Grünen-Lokalpolitiker bekam dafür seinerseits ein Strafverfahren wegen Volksverhetzung, worüber er sehr staunte, und 2024 sogar schon Schuldsprüche in nicht nur einer, sondern zwei Gerichtsinstanzen; seine politische Karriere ist erledigt. Anderen zur Warnung.

Als Hamburgs Innensenator während der Corona-Pandemie eine strenge Ermahnung an seine Bürgerinnen und Bürger aussprach, keine Partys zu feiern, dann aber dabei erwischt wurde, wie er selbst eine – illegale – Party mit Dutzenden Gästen zelebrierte, kommentierte der Betreiber einer Punkkneipe aus dem Stadtteil St. Pauli im sozialen Netzwerk X, das damals noch Twitter hieß, diese Heuchelei lakonisch: „Du bist so 1 Pimmel.“ Kurz darauf tauchten vier uniformierte, bewaffnete Beamte vor der Wohnungstür des Gastronomen auf. Sie durchsuchten Räume, beschlagnahmten Geräte. Ein weiteres Verfahren wegen Politikerbeleidigung begann.

Gestern erlaubt, heute verboten

Damit hatte der Hamburger Gastronom nicht gerechnet. Damit hätte aber auch ich, ein ausgebildeter Jurist, der an der juristischen Fakultät der Universität Frankfurt unterrichtet, nicht gerechnet. Selbst wenn man sich sehr anstrengt, im Bilde zu sein, die teils sehr weite neue Interpretation des Strafrechts und von solchen sehr offenen Begriffen wie „Beleidigung“ im Blick zu behalten und politisch informiert zu bleiben, kann man bei diesem Tempo der Entwicklung immer häufiger auch überrascht werden.

Und das ist, meine ich, ein Problem. Damit hat sich in diesem Land etwas verändert. Nicht nur die USA haben ein Problem mit der Meinungsfreiheit, sondern, auf unsere Weise, auch wir. Darum soll es in diesem Buch gehen. Der deutsche Staat definiert heute etliche Aussagen als strafbar, die noch vor zehn Jahren ganz klar unter die Meinungsfreiheit fielen. Die Schwelle, von der an Polizei und Justiz hierzulande von strafbarer „Hetze“ ausgehen, ist an etlichen Stellen rapide abgesenkt worden, teils durch Änderungen der Gesetze, teils durch eine Änderung der Gesetzesinterpretation. Gestern noch erlaubt, heute verboten: Das ist ein juristischer Großtrend, den ich darstellen, analysieren und auf den ich auch eine kritische Antwort zu formulieren versuchen möchte.

UN-Sonderberichterstatter entsetzt

Im Frühjahr 2025, als J. D. Vance in München war, war ich, umgekehrt, in den USA. Ich habe in Kalifornien an Universitäten geforscht, die gerade große Not hatten, sich gegen die autoritären Übergriffe der Trump-Regierung zur Wehr zu setzen. Ich habe mit Rechtswissenschaftlern zusammengesessen, die gerade dabei waren, sich für Proteste gegen diese Trump-Politik zu vernetzen. David Kaye zum Beispiel, der ehemalige UN-Sonderberichterstatter für das Menschenrecht auf Meinungsfreiheit, der mir sein Lieblingscafé in Santa Monica zeigte, vegan und hundefreundlich. Aber so groß ihr Entsetzen über die Trump-Pläne war, so wenig hat das gleichzeitig ihre Sorge über das gemindert, was sie von der anderen Seite des Atlantiks her mitbekamen. „Diese Razzien“, sagte David Kaye.

Als in Kalifornien der Sommer begann, brachte die Sendung 60 Minutes des US-Senders CBS eine Reportage aus – Niedersachsen. Eine amerikanische Reporterin interviewte zwei deutsche Staatsanwälte und eine Staatsanwältin, die auf die Verfolgung von Hatespeech spezialisiert waren. Die Strafverfolger erzählten von den inzwischen üblichen Hausdurchsuchungen wegen Online-Postings und den teils verdutzten Reaktionen der Betroffenen, die oft sagen würden: Sie hätten gar nicht gewusst, dass ihre Äußerungen verboten seien. So erzählte es einer der Staatsanwälte und grinste.

Voraussetzung jeder Freiheit

In Santa Monica sprach mich David Kaye darauf an. Er fand das befremdlich. Staatsanwälte, die sich nichts dabei zu denken schienen, dass sie Menschen überraschten mit der Information, dass etwas neuerdings verboten sei? Was sei das für ein Verständnis von Rechtsstaat? Und er wies mich noch auf einen weiteren Aspekt hin, der ihm Sorgen bereite. „Pimmel“ sei in den USA noch das Mildeste, was man an Spott über den Präsidenten lesen könne. Es geschehe praktisch jeden Tag, dass jemand ihn als „Schwachkopf“ bezeichne, als „dümmsten Präsidenten aller Zeiten“ sowieso. Das ist nach amerikanischem Recht straffrei, zum Glück. Nicht auszudenken, was Donald Trump anstellen könnte, wenn sich die USA mit ihrem Strafrecht ein Beispiel an Deutschland nähmen.

Die Meinungsfreiheit wird in Demokratien traditionell als das wichtigste aller politischen Grundrechte verstanden, weil sie sozusagen die Voraussetzung aller weiteren Freiheiten schafft. Sie ist die Basis, auf der man politisch überhaupt in einen Streit eintreten kann, Forderungen stellen, sich Gehör verschaffen und so weiter. Die Bundesrepublik war noch jung, es war 1952, da schrieben die Richter des Bundesverfassungsgerichts (in diesem Fall waren es sieben Männer und eine Frau) in einem ihrer ersten Urteile, dass die Meinungsfreiheit für eine Demokratie „schlechthin konstituierend“ sei. Sprachlich schöner, auch ein wenig pathetischer: Die Freiheit, seine Meinung zu sagen, sei „die notwendige Voraussetzung beinahe jeder anderen Form der Freiheit“, so lauten die berühmten Worte des einstigen amerikanischen Supreme-Court-Richters Benjamin Cardozo. Und, ja: Es darf auch polemisch sein. Überspitzt. Oder emotional. Jedenfalls bis hin zu einer Grenze.

Was würde Trump damit tun?

Ich frage mich inzwischen, ob wir uns in Deutschland nicht ganz schön schnell gewöhnt haben an die Alltäglichkeit von Hausdurchsuchungen wegen „Politikerbeleidigung“, an die grassierende Verunsicherung, ob man denn noch von einer „dümmsten Außenministerin der Welt“ sprechen darf, an die Tatsache, dass schwierige zivilgesellschaftliche Debatten eingeengt werden – und ich frage mich auch, ob eine offene Gesellschaft ihre Strafjustiz nicht an etlichen Stellen dringend zurückpfeifen müsste, braucht man doch gerade in volatilen Zeiten eher mehr Debatte, nicht weniger. In der amerikanischen Cartoon-Serie „South Park“ taucht derweil der amerikanische Präsident Donald Trump als Sexpartner des Teufels auf, und es werden Zoten gerissen über das kleine Gemächt des Commanders in Chief.

Wenn die USA unter Trump solche Gesetze hätten wie Deutschland, dann würde dies J. D. Vance und Co. noch ganz andere Möglichkeiten bieten, ihre Kritiker einzuschüchtern. Dieses Szenario, in dem ein rechtsautoritärer Regierungschef mit einem fragilen Ego à la Trump oder Vance seine Kritiker wegen krimineller „Beleidigung“ verfolgen lassen könnte: Liberale Amerikaner wie David Kaye sind heilfroh, dass dies gerade nicht ansteht und dass wahrscheinlich auch der amerikanische Supreme Court verhindern würde, dass solche Instrumente diesen Rechtspopulisten in die Hände fielen. In Deutschland, wo die Anklagebehörden in diesem Punkt immer mehr Macht und gesetzlichen Spielraum bekommen haben, ist dieses Szenario vielleicht nur eine Landtagswahl entfernt.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.