Merz will eine Klarnamenpflicht im Netz. Doch die verschlechtert das Leben vieler Menschen und bedroht gleich mehrere Grundrechte. Der Kanzler wäre gut beraten, die Forderung sofort wieder einzupacken – und stattdessen vor der eigenen Haustüre zu kehren. Ein Kommentar.

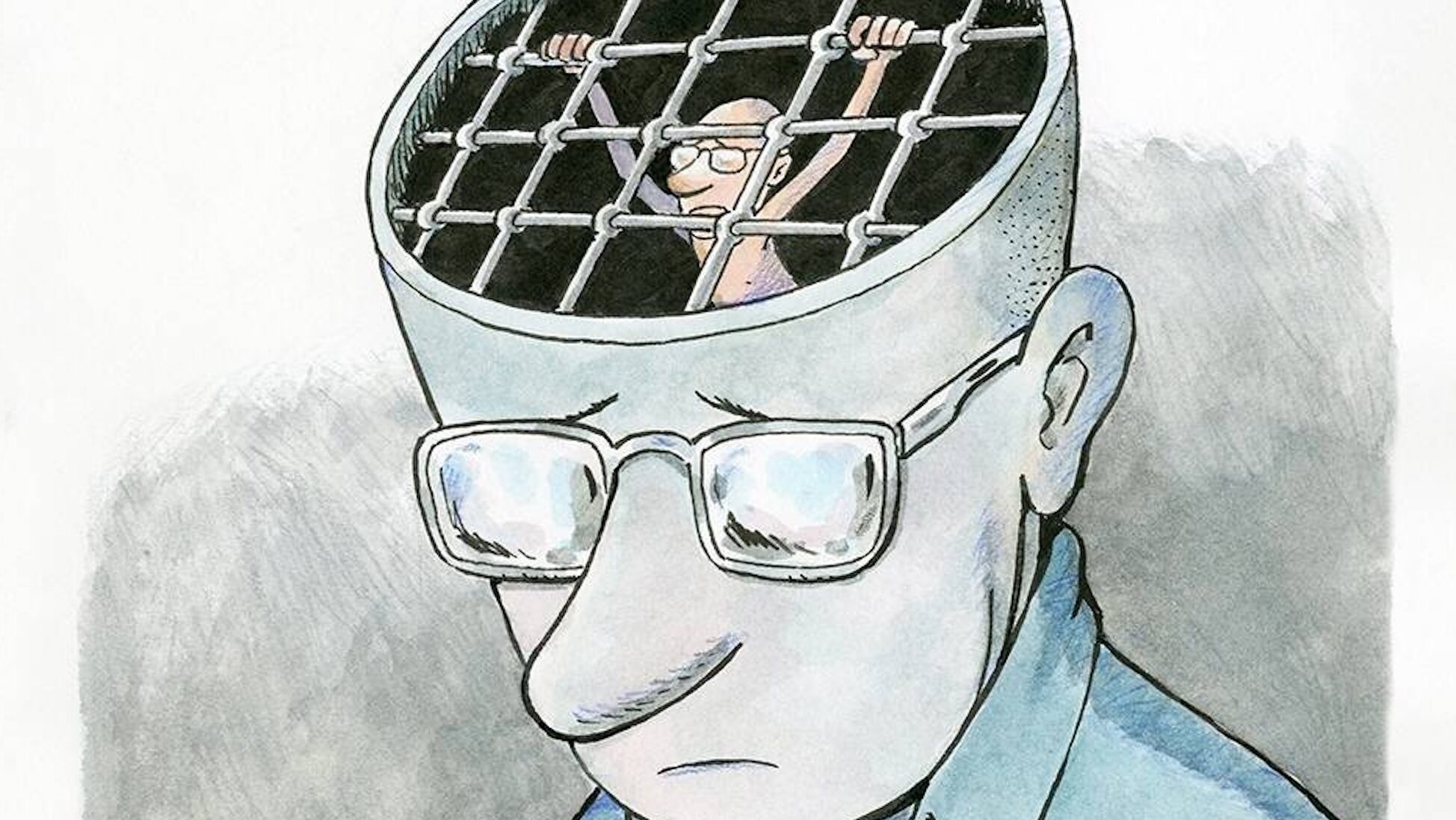

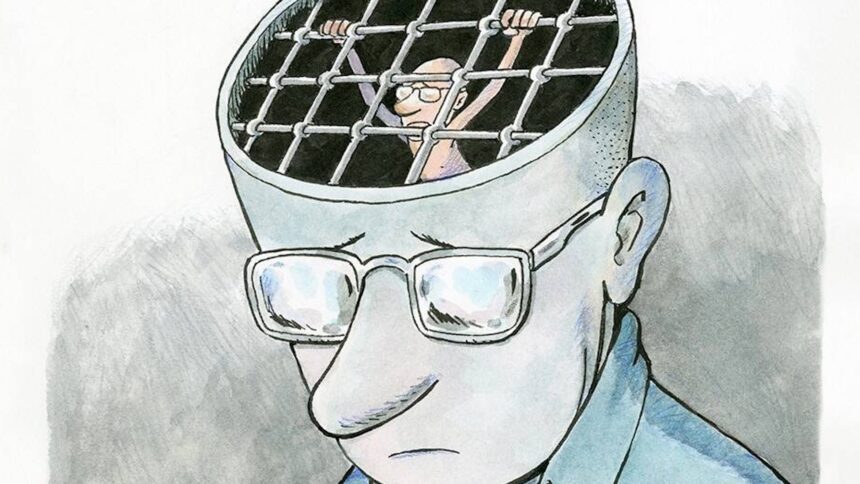

Nun hat also die uralte Forderung nach einer Klarnamenpflicht im Netz mit dem Bundeskanzler die höchste Ebene deutscher Politik erreicht. Besser wird die Forderung dadurch nicht. Eine Klarnamenpflicht ist nicht wirkungsvoll, sondern autoritär, falsch und extrem gefährlich für gleich mehrere Grundrechte.

Mit der derzeitigen Debatte um ein Social-Media-Verbot für Jugendliche, die vermutlich mit flächendeckenden Ausweiskontrollen umgesetzt würde, ergibt sich allerdings gerade ein Möglichkeitsfenster für diese Art der Einschränkung des freien Internets. Dabei ist die Debatte sogar schon soweit entgleist, dass sogar die im Gesetz als freiwillig festgeschriebene digitale Brieftasche der EU von Mitgliedern der Bundesregierung jetzt als Pflicht-Instrument zur Identifizierung gefordert wird.

Dabei ist eine Klarnamenpflicht im Internet und sozialen Netzwerken bislang als Unterdrückungsinstrument von autoritären Ländern wie China bekannt.

Für freie und demokratische Gesellschaften sind Anonymität und Pseudonymität im Internet jedoch unerlässlich. Dafür gibt es zahlreiche Gründe. Und nicht umsonst ist die Anonymität im Netz in Deutschland gesetzlich festgeschrieben.

Klarnamenpflicht verschlechtert das Leben vieler Menschen

Wer eine Klarnamenpflicht im Internet oder sozialen Netzwerken einführen will, verschlechtert das Leben vieler Menschen. Wir haben schon vor Jahren zahlreiche fiktive, aber alltägliche Beispiele aufgeschrieben, die zeigen, dass Pseudonymität und Anonymität dem Schutz der Grundrechte und der freien Entfaltung und Entwicklung von Menschen dienen.

Die Möglichkeit unter einem erfundenen Namen im Internet aufzutreten, ist elementar für die Pressefreiheit, die freie Entfaltung der Persönlichkeit, die Meinungsfreiheit, die Freiheit der Kunst, die informationelle Selbstbestimmung und die Religionsfreiheit. Wir alle brauchen anonyme Orte im Netz. Das trifft nicht nur für marginalisierte Gruppen und Minderheiten zu, aber für diese besonders.

Anonym heißt nicht gewaltvoll

Die Befürworter:innen der Klarnamenpflicht ignorieren die demokratische Notwendigkeit von Anonymität und Pseudonymität. Sie bleiben aber auch den Beweis schuldig, dass diese schwerwiegende Maßnahme überhaupt etwas bringt. Es ist nämlich alles andere als wissenschaftlich gesichert, dass durch eine Klarnamenpflicht der Diskurs befriedet wird.

Die Idee hinter der Forderung ist die Annahme, dass Menschen „mit offenem Visier“ zurückhaltender kommunizieren würden. Dafür gibt es wenig Belege. Im Gegenteil gibt es Studien, die zeigen, dass anonyme Nutzer:innen weniger aggressiv kommunizieren und solche die zeigen, dass Rassisten ganz offen hetzen.

Oftmals spielen Umfeld, Kultur und wirksame Moderation auf den jeweiligen Plattformen die entscheidende Rolle, wie diskutiert wird und wie Nutzer:innen auftreten. Dort wo Nutzer:innen selbst bestimmen können, wen sie aus ihrer Kommunikation ausschließen wollen, wird der Diskurs besser.

Es gibt zahlreiche Beispiele für Orte im Netz, in denen Menschen anonym oder pseudonym, aber vollkommen zivilisiert, achtsam und geregelt miteinander kommunizieren.

Rechtsdurchsetzung statt neuer Einschränkungen

Die Bundesregierung sollte nicht mit diesem gefährlichen Instrument gegen die Bevölkerung vorgehen. Sie sollte stattdessen das EU-Gesetz über digitale Dienste (DSA) gegen Plattformen durchzusetzen und gegen Plattformen vorgehen, wenn diese gegen EU-Gesetze verstoßen.

Man könnte den Kampf gegen Hass und Hetze in Form von gut ausgebildeten Polizeien und Staatsanwaltschaften unterstützen und Möglichkeiten schaffen, gegen strafbare Formen der Kommunikation einfacher und besser vorzugehen.

Schlüsselfertiges autoritäres Haus für die AfD

Was früher noch eine eher hypothetische Warnung von Bürgerrechtlern war, ist heute leider die neue Realität. Was passiert eigentlich, wenn wir autoritäre Instrumente in einer Demokratie schaffen, die dann in die Hände der Falschen fallen? Genau vor diesem Problem stehen wir.

Die gesichert rechtsextreme AfD ist kurz davor, stärkste Partei zu werden. Eine Klarnamenpflicht würde eine mögliche Absicherung der Macht der AfD unterstützen, wenn die Rechtsradikalen an die Regierung kommen. Man baut den Zerstörern der Demokratie unnötigerweise ein schlüsselfertiges Haus, das die diese gleich beziehen können – anstatt ihnen Steine in den Weg zu legen, wo man nur kann.

Kritik nur noch mit Nummernschild?

Vielleicht sollte Friedrich Merz zunächst bei sich selbst anfangen. Er könnte zum Beispiel noch heute aufhören, auf der Hass- und Hetzplattform X zu posten. Denn dort findet genau der vergiftete Diskurs statt, der nun kritisiert wird – er wird dort durch den Eigentümer Elon Musk sogar noch aufgeheizt und befeuert. Wer als Bundeskanzler so einer toxischen Plattform durch die eigene Anwesenheit Relevanz und Seriosität verleiht, sollte von gepflegten demokratischen Diskursen besser schweigen.

Merz hat zudem wenig verstanden von der demokratischen Wichtigkeit anonymer Kommunikation, wenn er die Klarnamenpflicht auf sich selbst bezieht und aus seiner privilegierten, mächtigen Rolle als Bundeskanzler eine Zwangsoffenlegung der Namen aller Menschen fordert, die „sich sich kritisch mit unserem Land und unserer Gesellschaft auseinandersetzen.“ Kritik nur noch mit Nummernschild, oder wie ist das zu verstehen?

In Merzens Kopf schwirrt vermutlich herum, dass er als Bundeskanzler öfter einmal Gegenstand von Beleidigungen ist. Die kann er allerdings mit der ganzen Macht eines Bundeskanzlers und der Unterstützung des Bundeskriminalamts bekämpfen. Aber Privilegien und die damit verbundene Verantwortung zu verstehen, war offenbar noch nie Sache eines Kanzlers, der Privatflugzeuge fliegt, aber sich zur Mittelschicht zählt.

Merz befeuert selbst die verrohte Debattenkultur

Die ohne Frage schlechter werdende Diskurskultur, die gesellschaftliche Verrohung und das feindliche Klima hängen unmittelbar mit dem Aufstieg der AfD und ihren Narrativen zusammen. Durch permanente Diskursverschiebung und anhaltende Abwertung von Menschen verschieben die Rechtsextremen die Grenzen des Sagbaren und ermutigen Menschen zu hetzen und Grenzen zu überschreiten.

Wenn ein Friedrich Merz selbst von „kleinen Paschas“ über muslimische Jugendliche redet oder davon, dass Geflüchtete einem die Zahnarzttermine wegnehmen, dann ist dies ein Ausdruck eben genau jener Entgrenzung, die wiederum andere motiviert auch entgrenzt zu kommunizieren.

Wer also Hass und Hetze im Netz verringern will, der sollte sich selbst mit Menschenfeindlichkeit und Diskriminierung zurückhalten – und lieber ganz konkret die AfD und ihre Diskurse bekämpfen statt diese in die demokratische Mitte zu heben und zu normalisieren.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.