Hinter dem Erfolg von Künstlicher Intelligenz und Sozialen Medien stecken ausgebeutete Arbeiter:innen. Bei einem Fachgespräch im Deutschen Bundestag wurde heute diskutiert, wie ihre Lage verbessert werden kann. Die Botschaft der Sachverständigen war klar: Deutschland muss mehr Verantwortung übernehmen.

Im Bundestag wurde heute erstmals über die Arbeitsbedingungen von Datenarbeiter:innen hinter Künstlicher Intelligenz und Sozialen Medien diskutiert. Die Ausschüsse für Digitales und Arbeit hatten zu einem Fachgespräch zum Thema Data Labeling geladen. Die klare Botschaft der drei Sachverständigen: Wenn Deutschland auf KI setzt, dann muss es mehr Verantwortung für die Menschen im Maschinenraum der Technologie übernehmen.

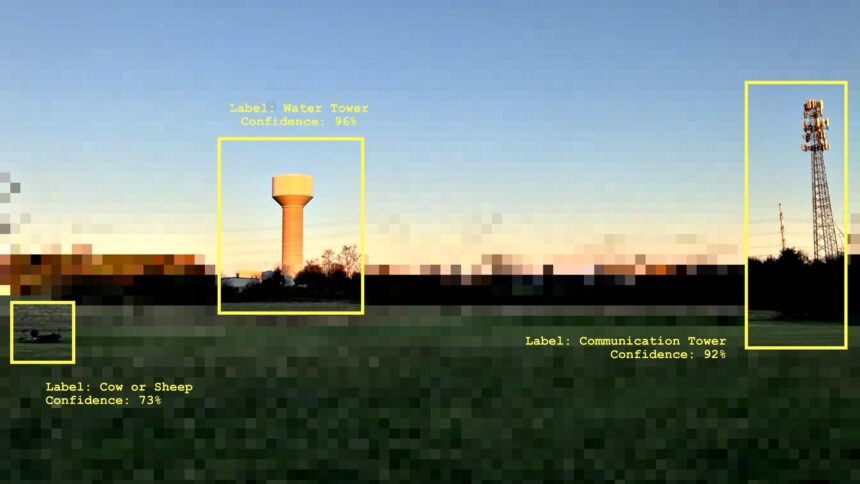

Als Data Labeling oder auch Daten-Annotation bezeichnet man eine Tätigkeit, bei der Menschen zum Beispiel Bildmaterial mit Metadaten versehen, also mit Labels, die den Inhalt beschreiben. Das ist unter anderem für Machine-Learning-Systeme erforderlich, die hinter fast allem stehen, auf dem heute das Label „KI“ klebt. Die Arbeiter:innen sind selten bei den Tech-Konzernen selbst beschäftigt, sondern werden häufig unter ausbeuterischen Bedingungen bei Outsourcing-Firmen oder -Plattformen angestellt.

Seit Jahren bringen Whistleblower:innen, Aktivist:inen, Forscher:innen und Journalist:innen die unsichtbar gemachten Arbeitskräfte in die Öffentlichkeit. Auch wir auf netzpolitik.org berichten kontinuierlich darüber. Die Arbeitsbedingungen in der Branche haben sich aber kaum verbessert, weshalb Erwartungen an die Politik groß sind. Das heutige Fachgespräch, an dem sich Abgeordnete von Union, SPD, Grünen und Linkspartei beteiligten, könnte ein Anfang sein. An konkreten Ideen, wie sich die Lage der Arbeiter:innen verbessern lässt, mangelt es jedenfalls nicht.

„Sie sehen die KI, aber uns sehen Sie nicht“

Die ehemalige Datenarbeiterin Joan Kinyua war virtuell aus der kenianischen Hauptstadt Nairobi zugeschaltet. Sie habe mehr als acht Jahre in der Branche gearbeitet hat, die „Künstlicher Intelligenz dabei hilft, die Welt zu verstehen“. Für unterschiedliche Anbieter habe sie unter anderem Bilder von Straßen mit Metadaten versehen, damit selbstfahrende Autos keine Unfälle bauen. Auch mit Straßenszenen aus Berlin habe sie arbeiten müssen (lest dazu mehr in unserem kürzlich veröffentlichten Interview mit Joan).

Später habe sie auch Bilder mit Gewaltdarstellungen klassifizieren müssen, sogar solche, die Gewalt an Kindern zeigten. Gleichzeitig habe sie selbst Daten für das KI-Training erzeugen sollen, indem sie Bilder ihrer Tochter zur Verfügung stellt.

Ausgeübt habe sie die Tätigkeit meist vom eigenen Computer zuhause, über sogenannte Microwork-Plattformen – „ohne Arbeitsvertrag, Sozialversicherung oder Gesundheitsversorgung“. Oft habe sie stundenlang auf neue Aufträge warten müssen, teilweise bis zu 20 Stunden am Tag auf Stand-By. Immer wieder hätten Auftraggeber:innen ihre Ergebnisse abgelehnt. Den Input hätten sie trotzdem behalten, sie selbst sei leer ausgegangen. So habe es Tage gegeben, an denen sie in fünf Stunden nur zwei Cent verdient habe. Im Schnitt würden Datenarbeiter:innen in Kenia 250 US-Dollar im Monat verdienen, was kaum zum Überleben reiche.

Von ihrer Arbeit habe sie außerdem Panik-Attacken und Angstzustände erhalten. Wie ihr gehe es vielen in der Branche, schildert Kinyua. Als Präsidentin der kenianischen Data Labelers Association vertrete sie inzwischen die Interessen von mehr als tausend Datenarbeiter:innen. Viele von ihnen litten unter posttraumatischen Belastungsstörungen.

„Sie sehen die KI, aber uns sehen Sie nicht“, so beschrieb Joan Kinyua den Abgeordneten ihre Lage. Es sei auch in der Verantwortung des Deutschen Bundestages, das zu ändern und für bessere Bedingungen zu sorgen. Unter anderem schlug die Kenianerin Mindeststandards für Datenarbeiter:innen in Deutschland und weltweit vor. Dazu zählt auch eine Obergrenze für die Arbeit an belastenden Inhalten. Zudem brauche es unabhängige Audits der Anbieter, sowie Register für KI-Arbeiter:innen und ganz grundsätzlich mehr Transparenz über Outsourcing und Lieferketten von Tech-Konzernen.

Milliarden-Profite dank Prekarisierung

Dr. Milagros Miceli von der TU Berlin berichtete von ihren Erkenntnissen aus fast einem Jahrzehnt Forschung zu Datenarbeit. Die von Joan Kinyua geschilderten Arbeitsbedingungen seien „kein Einzelfall, sondern ein konstantes Muster“. Oder genauer gesagt: das Geschäftsmodell einer milliardenschweren Branche.

Der von ihr geprägte Begriff der Datenarbeit umfasse mehr als das Labeling von Daten im engeren Sinne: Auch das Generieren und Sammeln von Daten zähle dazu, in zunehmendem Maße außerdem die Validierung des algorithmischen Outputs und das Korrigieren von Fehlern. Zudem müssten Arbeiter:innen immer wieder so tun, als seien sie eine KI.

Miceli ist eine der Initiator:innen des „Data Workers Inquiry“, in dem Datenarbeiter:innen von ihrer Wirklichkeit berichten. Kürzlich hat das Projekt die Geschichte einer Person veröffentlicht, die sich als AI Girlfriend ausgeben musste, also als Chatbot, der eine Liebesbeziehung mit seinen Nutzer:innen simuliert.

Die unterschiedlichen Formen der Datenarbeit seien essenzieller Bestandteil von KI-Produkten, einer Studie zufolge würde sie 80 Prozent der Entwicklungsarbeit von Künstlicher Intelligenz ausmachen. Miceli ist in ihrer Botschaft deshalb klar: „Ohne Datenarbeit und ohne Menschen wie Joan Kinyua gibt es keine KI“. Tech-Konzerne würden Milliarden damit verdienen „dass sie Arbeiter:innen durch Outsourcing und Plattformisierung prekarisieren und austauschbar machen“. Wenn Deutschland KI fördern wolle, müsse deshalb unbedingt für bessere Arbeitsbedingungen sorgen.

Viele der Arbeiter:inen seien hochqualifiziert, hätten Bachelor-Abschlüsse oder sogar promoviert, berichtet die Forscherin. Dabei sei wichtig, dass die Tätigkeit nicht auf Länder wie Kenia beschränkt ist, sondern auch in Deutschland und Europa viele Menschen in der Branche tätig seien. Wie viele genau, das könne man aufgrund der Intransparenz der Unternehmen nicht sagen.

Probleme bei Gesundheits- und Datenschutz

Bekannt ist, dass mehrere Tech-Konzerne und Outsourcing-Unternehmen in Deutschland große Zentren für die Moderation von Inhalten auf Social-Media-Plattformen unterhalten. Eine Tätigkeit, die die Sachverständigen ebenfalls zum Feld der Datenarbeit zählt und die bereits vor drei Jahren bei einem Fachgespräch im Bundestag Thema war. Julia Kloiber vom Superrr Lab war damals bereits dabei und wies heute erneut darauf hin, dass dabei oft Menschen in vulnerablen Lebenssituationen ausgenutzt würden.

Kloiber empfahl unter anderem besseren Schutz für Menschen, die mit schädlichen Inhalten arbeiten müssen. Bei der Polizei etwa, wo ebenfalls Menschen mit Darstellungen von Kindesmissbrauch arbeiten müssten, gebe es klare Expositionsbegrenzungen. Auch für Datenarbeiter:innen brauche es eine Obergrenze, die die Arbeit mit belastendem Material festlegt. Außerdem brauche es Trauma-Prävention und Zugang zu professioneller psychologischer Unterstützung.

Der fehlende Schutz habe nicht nur schwerwiegende Folgen für die Betroffenen, sondern auch für das Gesundheitssystem, schließlich könnten Menschen ein ganz Leben lang unter posttraumatischen Belastungsstörungen leiden. Manchmal könnten sie deshalb nicht mehr arbeiten. Die dadurch entstehenden Kosten würden von den Tech-Konzernen externalisiert und von der Allgemeinheit aufgefangen.

Kloiber wies zudem auf Datenschutzprobleme beim Outsourcing hin: Nicht nur würden die Datenarbeiter:innen selbst stark überwacht, bei ihnen landeten auch große Mengen personenbezogener Daten und sensibler Inhalte. Erst kürzlich hatten Datenarbeiter:innen als Whistleblower:innen darüber berichtet, dass sie Aufnahmen aus Meta-Brillen bearbeiten müssten und dabei auch Nacktaufnahmen und andere intime Szenen von Nutzer:innen zu Gesicht bekämen.

„Unsere digitale Zukunft darf nicht auf Ausbeutung fußen“

Deutlich wurde bei dem Fachgespräch, dass auch deutsche Firmen davon profitieren, dass sie prekäre Arbeit an Menschen wie Joan Kinyua auslagern. Auch die Auto-Industrie, die Pharma-Branche oder Tech-Unternehmen wie Siemens gehörten zu den Kunden von Outsourcing-Unternehmen im Datenbereich, berichtete etwa Milagros Miceli.

Für Julia Kloiber ist klar, dass Deutschland deshalb auch Verantwortung übernehmen müsse. Eine Untersuchung des Fairwork-Projekt der Universität Oxford und Wissenschaftszentrums Berlin habe die Löhne von vier Outsourcing-Unternehmen untersucht. Nur zwei von ihnen hätten Mindestlohn gezahlt, keines den sogenannten Existenzlohn („Living Wage“), der nicht nur das bloße physische Überleben, sondern auch soziale und kulturelle Teilhabe ermöglicht.

Einen wichtigen Ansatzpunkt sieht die Geschäftsführerin des Superrr Lab deshalb in der Regulierung von Lieferketten. Hier drohe der hohe Standard des erst kürzlich eingeführten und dann schon wieder halb gecancelten deutschen Lieferkettengesetzes abgesenkt zu werden. Die Schwarz-Rote Koalition hatte sich darauf geeinigt, nicht über die – ebenfalls gerade ausgehöhlte – EU-Lieferkettenrichtlinie hinauszugehen.

Bei der Umsetzung der Richtlinie müsse Deutschland sicherzustellen, dass der Geltungsbereich nicht eingeschränkt werde. Die EU-Regeln sollen nur Unternehmen ab 5000 Beschäftigten und einem Umsatz von 1,5 Milliarden Euro gelten. In Deutschland würden dann 95 Prozent der Unternehmen von den Sorgfaltspflichten für ihre Lieferketten entbunden, so Kloiber.

Die Expertin brachte zudem ein Direktanstellungsgebot ins Spiel, wie es erst kürzlich gefeuerte und streikende TikTok-Angestellte in Deutschland gefordert hatten. Ganz grundsätzlich fordert Kloiber eine realistischere Kosten-Nutzen-Rechnung, wenn in Deutschland KI ausgebaut und etwa in der Verwaltung eingesetzt wird. Soziale und auch ökologische Kosten dürften nicht länger ausgeblendet werden: „Unsere digitale Zukunft darf nicht auf Ausbeutung fußen.“

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.